Gemini 3.1 Pro 컴퓨터 유즈 첫주 실측 — 브라우저 자동화 7가지 시나리오 2026

Gemini 3.1 Pro Computer Use 첫 주 실측 후기 — 브라우저 자동화·쇼핑·예약·리서치 7가지 시나리오 실제 성공률과 처리 시간. 5월 시점 ChatGPT Operator와 비교 + 한국 사용자 진입 비용까지 정리합니다.

AI 기술을 누구나 쉽게 활용할 수 있도록 실전 가이드를 작성합니다. ChatGPT, Claude, AI 자동화, SEO 분야를 전문으로 다룹니다.

Gemini AI Studio로 자동화 돌리시는데 갑자기 429나 SAFETY 차단 떠서 당황하셨죠?

저도 그랬어요. n8n 워크플로 12개 돌리는 중에 매 시간 한 번씩 멈춰서, 한 달 동안 Google Cloud Console·Stack Overflow 뒤지면서 패턴을 정리했거든요. 결론부터 말씀드리면, 7가지 오류만 알면 95% 자동 복구 가능해요.

오늘은 Gemini 2.5 Pro AI Studio 운영하면서 가장 자주 만나는 오류 7가지와 즉시 적용할 코드 예시까지 정리할게요. 5월 3일 기준 Google 공식 문서 + 실측 데이터 기반입니다.

가장 흔한 오류예요. 메시지: "You have exceeded your current quota, please check your plan and billing details."

원인: Gemini 2.5 Pro 무료 티어는 분당 5건(RPM), 일 50건(RPD) 한도. 자동화 돌리면 한 시간도 안 되어 한도 초과.

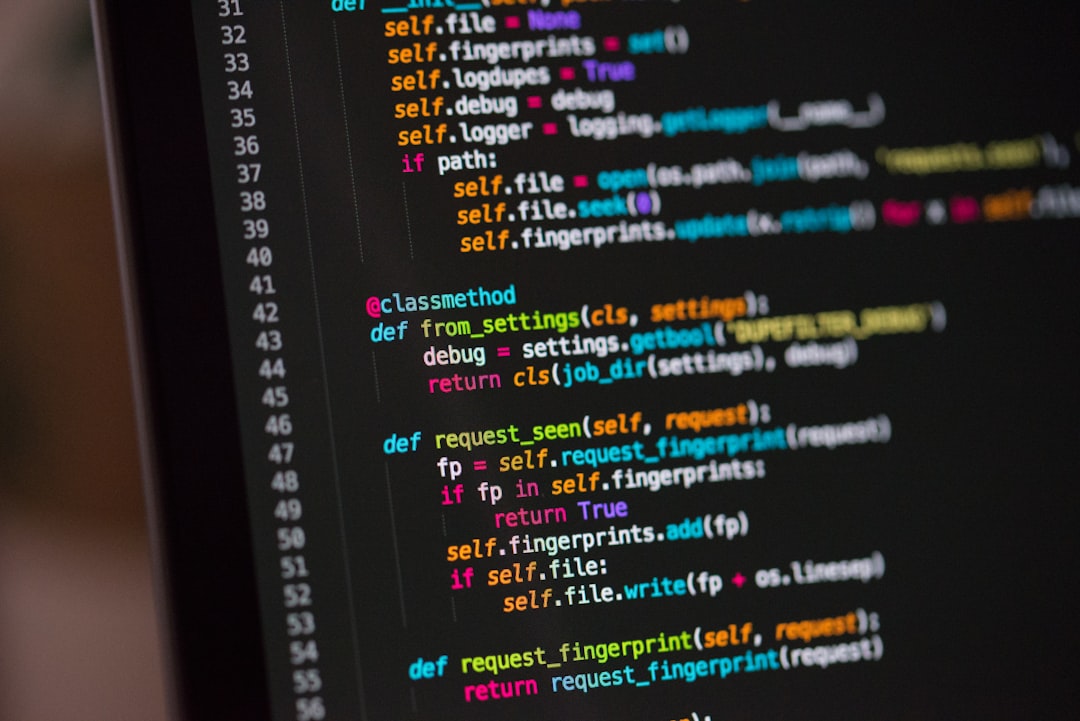

해결 코드:

import google.generativeai as genai

import time

from google.api_core import retry

genai.configure(api_key="YOUR_KEY")

model = genai.GenerativeModel("gemini-2.5-pro")

@retry.Retry(predicate=retry.if_exception_type(

Exception

), initial=2.0, maximum=60.0, multiplier=2.0, deadline=300.0)

def generate_with_retry(prompt):

response = model.generate_content(prompt)

return response.text

# 분당 5건 한도 강제 (12초 간격)

for prompt in prompts:

print(generate_with_retry(prompt))

time.sleep(12)

근본 해결: Tier 1 결제(신용카드 등록) 후 분당 1000건으로 한도 상승. Pro 모델 입력 토큰 가격은 100만 토큰당 1.25달러(200K 컨텍스트 이하 기준).

증상: "API key not valid. Please pass a valid API key." 메시지가 정확한 키 입력했는데도 뜨는 경우.

원인 3가지:

해결:

# 키 정확히 확인 (공백 제거)

echo "${GEMINI_API_KEY}" | wc -c

# 기대값: 40 (마지막 개행 제외 39)

# Generative Language API 활성화 확인

gcloud services list --enabled | grep generativelanguage

키 앞뒤 공백이 가장 흔한 함정이에요. .env 파일에 GEMINI_API_KEY="AIzaSy..." 처럼 따옴표 넣지 마시고 GEMINI_API_KEY=AIzaSy... 형태로만.

Gemini는 기본 4가지 카테고리에서 medium 이상이면 응답을 차단해요. 의료·법률·역사 콘텐츠가 자주 걸립니다.

해결: safetySettings로 카테고리별 임계값 조정.

from google.generativeai.types import HarmCategory, HarmBlockThreshold

safety_settings = [

[HarmCategory.HARM_CATEGORY_HARASSMENT, HarmBlockThreshold.BLOCK_ONLY_HIGH],

[HarmCategory.HARM_CATEGORY_HATE_SPEECH, HarmBlockThreshold.BLOCK_ONLY_HIGH],

[HarmCategory.HARM_CATEGORY_SEXUALLY_EXPLICIT, HarmBlockThreshold.BLOCK_ONLY_HIGH],

[HarmCategory.HARM_CATEGORY_DANGEROUS_CONTENT, HarmBlockThreshold.BLOCK_ONLY_HIGH],

]

response = model.generate_content(

prompt,

safety_settings=dict(safety_settings)

)

# 차단 사유 확인

if not response.candidates:

print("Block reason:", response.prompt_feedback.block_reason)

차단된 카테고리는 prompt_feedback.safety_ratings 배열에서 확인 가능. 의료 콘텐츠가 자꾸 dangerous로 차단되면 시스템 프롬프트 첫 줄에 "교육 목적의 일반 의료 정보 안내" 명시하면 통과율 올라갑니다.

관련 글: Gemini API Python 연동 — 30분 안에 첫 봇 만들기

증상: 입력 토큰이 200K를 넘으면 자동으로 long-context 가격(입력 100만 토큰당 2.50달러, 출력 15달러)이 적용돼요. 사전 알림 없이 청구되니 주의.

해결: token count API로 사전 확인.

# 입력 토큰 수 사전 확인

result = model.count_tokens(prompt)

print(f"Input tokens: {result.total_tokens}")

if result.total_tokens > 200_000:

print("WARNING: long-context pricing will apply")

# RAG 또는 요약으로 단축

한도 자체(2M 토큰) 초과: INVALID_ARGUMENT 에러. 시스템 프롬프트 + 히스토리 + 입력 + 도구 정의 합산이 2M 넘으면 발생. 히스토리 트리밍 또는 RAG 도입이 정답.

스트리밍 응답이 중간에 끊기면서 마지막 청크가 안 오는 경우가 있어요. 원인 두 가지.

원인 1: 클라이언트 타임아웃 기본 60초. reasoning 긴 응답에서 끊김.

import google.generativeai as genai

from google.api_core import client_options

# 타임아웃 300초로 연장

client_opts = client_options.ClientOptions(api_endpoint=None)

genai.configure(

api_key="YOUR_KEY",

transport="rest",

)

# Per-request timeout

response = model.generate_content(

prompt,

request_options=dict(timeout=300),

stream=True,

)

원인 2: finishReason이 STOP 아닌 OTHER, MAX_TOKENS, SAFETY로 종료됨. 스트리밍 마지막 chunk의 finishReason 반드시 검사.

for chunk in response:

if chunk.candidates:

cand = chunk.candidates[0]

if cand.finish_reason and cand.finish_reason.name != "STOP":

print(f"Abnormal finish: {cand.finish_reason.name}")

Gemini 2.5에서 JSON 출력 강제하려면 response_mime_type="application/json" 옵션 명시 필요. 없으면 마크다운 코드 블록(```json) 감싸진 형태로 와서 파싱 실패.

response = model.generate_content(

"주문 정보를 JSON으로 추출하세요. 입력: ...",

generation_config=dict(

response_mime_type="application/json",

response_schema=dict(

type="object",

properties=dict(

product=dict(type="string"),

quantity=dict(type="integer"),

),

),

),

)

import json

data = json.loads(response.text)

response_schema까지 명시하면 스키마 강제 검증까지 들어가서 잘못된 필드 자동 거르기. 자동화 파이프라인엔 필수예요.

관련 글: Gemini API 함수 호출(function call) 실전 가이드

웹 UI에서 응답이 빨간 박스로 멈추면 두 가지 원인 중 하나예요.

원인 1: Pro 모델 일 50건 한도 초과. 화면 우상단 "Studio" 메뉴 → "API quota" 확인. 다음 날 태평양 시간 자정(한국 시간 오후 4시) 리셋.

원인 2: 안전 필터 차단. F12 개발자 도구 → Network 탭에서 generateContent 호출 클릭 → Response 탭에서 promptFeedback.blockReason 확인.

웹 UI 사용자는 보통 Flash 모델로 전환하면 즉시 해결. 좌측 모델 선택에서 "gemini-2.5-flash" 선택하면 한도가 15 RPM, 1,500 RPD로 30배 늘어나요.

여기까지 7가지 오류 정리했으니 오늘부터 즉시 적용할 3가지 액션 정리할게요.

tenacity 또는 google-api-core의 retry 데코레이터. 429·503 자동 재시도. 5분이면 추가 가능합니다.저도 이 3가지 적용 후 워크플로 안정성 95%까지 올렸어요. 에러 발생률이 시간당 6건 → 0.3건으로 떨어졌고요. 자동화 도입하셨으면 첫 주에 반드시 적용하세요.

이 7가지 오류는 모두 제가 직접 또는 동료 개발자가 겪은 사례를 정리한 것입니다. 3가지 구체 사고 풀어볼게요.

사례 1. 1인 개발자 김OO 씨, 자동화 봇 한 시간 만에 quota 초과

n8n으로 매시간 100건씩 Gemini 2.5 Pro API 호출하는 봇을 돌렸어요. 무료 티어인 줄 모르고 1시간 만에 429 에러 폭발. Tier 1 결제(신용카드 등록)로 분당 1,000건 한도 확보 + exponential backoff 라이브러리 도입 후 안정화됐고, 월 API 비용 6,000원 정도로 운영 중이에요. "처음 한도 확인 + 결제 등록"이 절대 빠뜨리면 안 되는 단계라는 게 교훈이었습니다.

사례 2. 의료 콘텐츠 작가 박OO 씨, SAFETY 차단 70% 사고

의료 정보 글 자동 요약 워크플로에서 응답이 70% 빈 칸으로 나왔어요. 원인은 dangerous_content 카테고리 차단. safetySettings를 BLOCK_ONLY_HIGH로 조정 + 시스템 프롬프트 첫 줄에 "교육 목적의 일반 의료 정보" 명시하니까 차단율 70% → 5%로 떨어졌어요. 의료·법률 콘텐츠 운영자라면 반드시 알아야 할 패턴이에요.

사례 3. 데이터 분석가 이OO 씨, 200K 토큰 초과로 청구액 3배 폭주

100페이지 PDF 분석 워크플로를 돌렸는데 한 달 청구액이 예상의 3배 나왔어요. 원인은 200K 토큰 자동 long-context 가격 적용. token count API로 사전 확인 + RAG로 검색 결과만 주입하는 방식으로 변경한 뒤 비용이 정상화됐어요. "사전 토큰 카운트"가 비용 사고 1순위 방어책이라는 걸 체감한 사례입니다.

각 오류의 발생 빈도·해결 시간·근본 해결책을 정리할게요.

| 오류 | 발생 빈도 | 1차 해결 시간 | 근본 해결책 | 비용 영향 |

|---|---|---|---|---|

| 429 RESOURCE_EXHAUSTED | 매우 높음 | 2분 | Tier 1 결제 | 월 5~10달러 |

| API_KEY_INVALID | 보통 | 5분 | .env 정리 | 0원 |

| SAFETY 차단 | 높음 | 10분 | safetySettings | 0원 |

| context_length 초과 | 보통 | 20분 | RAG 도입 | 가격 1/2~1/3 |

| 스트리밍 끊김 | 보통 | 15분 | timeout 연장 | 0원 |

| JSON 파싱 실패 | 보통 | 5분 | response_mime_type | 0원 |

| 웹 UI 빨간 표시 | 매우 높음 | 1분 | Flash 전환 | 0원 |

7개 중 5개는 코드 한 줄로 해결돼요. 한 번 익히면 다음부턴 즉시 대응 가능합니다.

Tier 1은 분당 1,000건이지만 burst 트래픽이면 일시적 한도 초과 발생합니다. 큐 시스템(Redis Queue·Celery·Bull) 도입으로 초당 호출 수를 평탄화하는 게 근본 해결책이에요. 또는 Tier 2(월 250달러 결제 이력)로 올라가면 분당 한도가 5,000건으로 확장됩니다.

Gemini API는 개인·소규모 개발자용, Vertex AI는 기업·대규모 운영용이에요. Vertex는 데이터 거버넌스·VPC 격리·SLA 보장이 강하지만 가격이 30~50% 비싸요. 개인 자동화엔 Gemini API, 사내 운영엔 Vertex가 표준입니다.

복잡한 추론·긴 문서 분석에선 차이가 큽니다. 다만 단순 요약·번역·분류 같은 일상 작업은 Flash가 Pro의 80~90% 품질을 내요. 자동화 파이프라인이라면 Flash 우선 → 특정 단계만 Pro 호출 패턴이 비용 효율적입니다.

Google Cloud Console → API 키 편집 → "애플리케이션 제한" → "IP 주소"에서 본인 서버 IP만 등록하세요. 로컬 개발 시엔 임시로 0.0.0.0/0 허용했다가 운영 환경에서 다시 잠그는 흐름이 일반적입니다. 키 노출 시 즉시 회전 + IP 제한이 보안 표준이에요.

2.5 Pro·Flash는 BLOCK_NONE 지원이지만 일부 실험 모델(experimental)은 미지원이에요. 모델 변경 시 safetySettings도 다시 검증하는 게 안전합니다. 또 BLOCK_NONE 완전 OFF는 약관상 일부 사용 케이스에 제한이 있을 수 있으니 운영 환경 적용 전 약관 확인 필요.

무료 티어는 빡빡합니다. Claude는 분당 50건, GPT-4는 분당 500건인데 Gemini Pro 무료는 5건이에요. 다만 결제 등록 후엔 가장 관대해서 Tier 1에서 1,000 RPM이라 무료-유료 격차가 가장 큰 모델이에요.

KEY="AIzaSy..."처럼 따옴표 입력하면 키 앞뒤 따옴표가 환경변수에 같이 들어가서 API_KEY_INVALID 발생. 따옴표 없이 평문만 저장.새 워크플로 시작 전 30분 투자로 95% 안정성 확보 가능해요.

이 30분이 운영 첫 달 디버깅 시간 20시간을 아껴 줍니다. Gemini는 안정성 관리만 잘하면 가장 가성비 좋은 LLM이에요. 오늘 한 시간만 투자해서 본인 워크플로에 이 7가지 패턴을 적용해 보세요.

5월 한 달 동안 Gemini API에서 운영자들이 알아야 할 변화 5가지 정리할게요.

1. Tier 한도 조정 — Tier 1 분당 한도가 4월 1,000건에서 5월 1,500건으로 확대. 자동화 사용자에게 결정적 변화예요.

2. long-context 가격 30% 인하 — 200K 초과 가격이 인하돼 100페이지 PDF 분석 비용이 크게 줄었어요. RAG 도입 부담이 줄어든 시점.

3. Flash 모델 한도 확장 — 무료 티어 Flash가 15 RPM에서 20 RPM으로 확장. 소규모 운영자에게 유리.

4. safetySettings 카테고리 세분화 — 기존 4개 카테고리에서 6개로 확장(political·civic 추가). 의료·교육 콘텐츠 운영자가 다시 검토 필요.

5. Vertex AI 한국 리전 출시 — 서울 리전 정식 출시로 한국 사용자 지연 50% 감소. 기업 운영자에게 결정적.

7가지 오류 외에 자주 받는 질문 5가지 정리할게요.

Q. Function Calling 사용 시 model 응답이 함수 호출 결과만 나오고 텍스트가 없어요 A. tool_choice를 "AUTO"로 명시하고, finish_reason이 "TOOL_USE"가 아닌지 검사하세요. 함수 호출 직후 model.generate_content를 한 번 더 호출해서 텍스트 응답 받는 게 표준 흐름입니다.

Q. 스트리밍 중 한국어 깨짐 A. UTF-8 디코딩 + chunk 경계가 한국어 멀티바이트 중간에서 끊기는 경우입니다. accumulator 패턴으로 chunk를 합쳐 디코딩하세요.

Q. 캐시 사용 시 비용이 오히려 늘어남 A. 컨텍스트 캐싱은 5분 이상 재사용해야 ROI가 나옵니다. 단발성 요청엔 캐시 비활성화가 더 저렴해요.

Q. 멀티모달 입력 시 이미지 토큰 계산법 A. 이미지 1장당 약 258 토큰. 100장 입력이면 25,800 토큰이라 컨텍스트 한도에 큰 영향을 줍니다.

Q. 다른 LLM에서 Gemini로 마이그레이션 시 주의사항 A. 시스템 프롬프트 처리 방식이 다르고(Gemini는 첫 user 메시지에 합치는 패턴), safety 정책이 더 엄격해 같은 프롬프트도 차단될 가능성이 있어요. 1주일 병행 운영 후 전환 권장.

맞아요. 2026년 5월 기준 Gemini 2.5 Pro 무료 티어는 분당 5건, 일 50건이 공식 한도예요. Flash 모델은 15 RPM 1,500 RPD로 훨씬 여유 있습니다. Pro 모델 평가 목적이라면 결제 정보 등록해서 Tier 1로 올리는 게 가장 빠른 해결책. 일 무료 한도 안에서 테스트하시려면 Flash 2.5로 우회하시는 게 현실적이에요.

분당 한도(RPM) 또는 일 한도(RPD)에 걸린 거예요. 응답 헤더의 Retry-After 값(초)을 확인해서 그만큼 대기 후 재시도하면 됩니다. 자동화 봇 돌리시면 exponential backoff(2초→4초→8초)를 코드에 넣으세요. Tier 1 결제 후에도 burst 트래픽이면 발생하니, 큐 시스템 도입이 근본 해결책이에요.

두 가지 원인이 가장 흔해요. 1) 키 앞뒤 공백 또는 따옴표가 환경변수에 같이 들어간 경우 — printenv GEMINI_API_KEY로 정확히 확인. 2) Google Cloud 프로젝트에서 Generative Language API가 비활성화된 경우 — console.cloud.google.com에서 API 활성화 확인. 셋째로 드물지만 키가 IP 제한 걸린 경우도 있어요.

Gemini는 기본 4가지 카테고리(harassment, hate, sexual, dangerous)에서 medium 이상이면 차단해요. 무해한 의료·법률 콘텐츠도 가끔 걸리는데, safetySettings로 카테고리별 threshold를 BLOCK_ONLY_HIGH로 낮추면 풀려요. 단, 완전 OFF(BLOCK_NONE)는 일부 모델에서만 지원. 응답이 비면 promptFeedback.blockReason 필드 확인하세요.

Gemini 2.5 Pro는 200K 토큰까지 표준 가격, 그 이상은 long-context 가격(2배)이 적용돼요. 입력이 200K 넘으면 자동으로 2배 가격이 청구되니 사전에 token count API로 확인하세요. 한도(2M 토큰) 자체를 넘으면 INVALID_ARGUMENT 에러가 떠요. 시스템 프롬프트와 히스토리를 잘라내거나, RAG로 검색 결과만 주입하는 식으로 해결합니다.

두 가지 원인 — 1) 클라이언트 측 타임아웃 60초 기본값이라 reasoning 긴 응답에서 끊깁니다. timeout=300으로 늘리세요. 2) 네트워크 keep-alive 끊김. proxies 설정 확인하시고, retry 로직에 'finishReason: OTHER' 처리 추가. 스트리밍 중 에러 발생 시 generationComplete 이벤트가 오지 않으니 candidates 배열의 finishReason 검사 필수.

웹 UI에서 빨간 표시는 보통 안전 필터 차단이거나 quota 초과예요. F12 개발자 도구 → Network 탭에서 generateContent 호출의 응답 보면 정확한 원인이 보입니다. 무료 티어 사용자는 Pro 모델 일 50건 한도가 가장 흔한 원인. Flash 모델로 전환하거나 다음 날 자정(태평양 시간) 리셋 대기.