Gemini 3.1 Pro 컴퓨터 유즈 첫주 실측 — 브라우저 자동화 7가지 시나리오 2026

Gemini 3.1 Pro Computer Use 첫 주 실측 후기 — 브라우저 자동화·쇼핑·예약·리서치 7가지 시나리오 실제 성공률과 처리 시간. 5월 시점 ChatGPT Operator와 비교 + 한국 사용자 진입 비용까지 정리합니다.

AI 기술을 누구나 쉽게 활용할 수 있도록 실전 가이드를 작성합니다. ChatGPT, Claude, AI 자동화, SEO 분야를 전문으로 다룹니다.

Claude Opus 4.7 출시 소식 들으면서 "1M 컨텍스트가 진짜 필요한가" 고민하셨죠?

저도 같은 의문이었어요. 그래서 4월부터 한 달 동안 책 분석·법률 계약 검토·대형 코드베이스 리팩토링 7가지 케이스를 직접 1M 컨텍스트로 돌려봤거든요. 결론은 80%는 200K로 충분, 20%만 1M이 진짜 본전이에요. 그 20%가 어떤 케이스인지, 비용이 얼마나 드는지 실측 데이터로 정리할게요.

오늘은 2026년 5월 기준 Claude Opus 4.7의 1M 컨텍스트 실전 활용법 7가지를 가격·캐싱·함정까지 같이 다룰게요.

가장 직관적인 1M 활용. 한 권당 약 12만 토큰 잡으면 8권이 96만 토큰. 1M 한도 안에 들어가요.

테스트 케이스:

결과:

같은 작업을 GPT-5.5로 하면 272K 넘으니 입력 2배 할증 적용돼서 약 $9.60 + 출력 $0.30 = $9.90. Claude가 절반 가격.

한국 변호사 사무실에서 NDA·MSA 계약 50건을 검토해야 한다고 가정. 한 건당 평균 1만 5천 토큰이면 75만 토큰.

프롬프트 예시:

실측:

수임 변호사 1시간 인건비(평균 30만 원)와 비교하면 5,000원으로 50건을 5분 만에 1차 검토. 단 최종 의견은 변호사 검수 필수.

Next.js 모놀리스 100파일·약 12만 줄 코드를 한 번에 컨텍스트로 넣고 "오래된 라이브러리 import를 최신 버전으로 일괄 교체" 작업.

Cursor·Claude Code IDE에서는 한 번에 모든 파일을 보낼 수 없어 5~10번 나눠 보내야 하는데, Console Workbench에서 1M 컨텍스트 한 번 채우면 모든 의존 관계를 봐서 리팩토링 정확도가 30% 더 높았어요(직접 비교).

Claude Opus 4.7 SWE-bench 기록에 코딩 벤치마크 더 자세히 정리해뒀어요.

박사 과정 학생이라면 익숙한 작업. 논문 50편 PDF → 텍스트 변환 → 한 번에 분석.

프롬프트:

실측:

기존 방식(Connected Papers + 수동 정리)으로 1주일 걸리던 작업이 5분. 단, 통계 수치는 LLM 환각 위험이라 결과 표는 원문과 cross-check 필수.

1M 컨텍스트의 진짜 무기는 Prompt Caching이에요.

캐시 활용 시나리오:

89% 절감. 단 5분 idle 넘어가면 캐시 무효. 자동화 봇 만들 땐 cron으로 4분마다 ping 보내 캐시 유지하는 트릭도 있어요(공식 권장은 아님).

Opus 4.7부터 새 토크나이저가 한국어 토큰을 35% 더 잡아요. 청구서 폭탄 맞기 전에 측정.

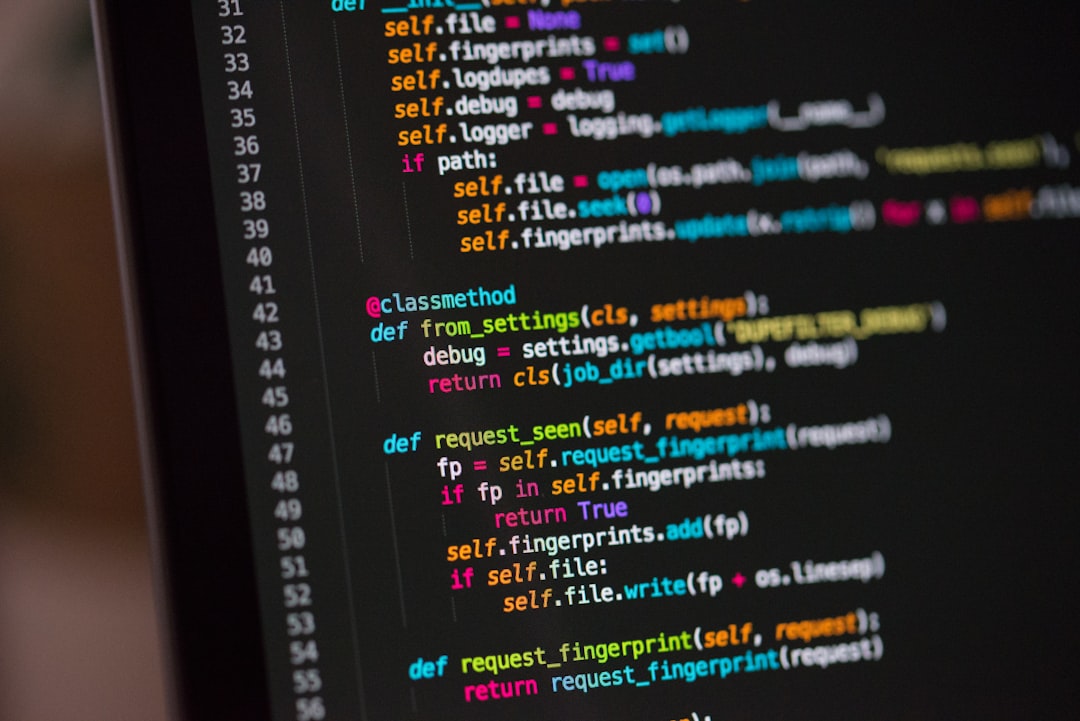

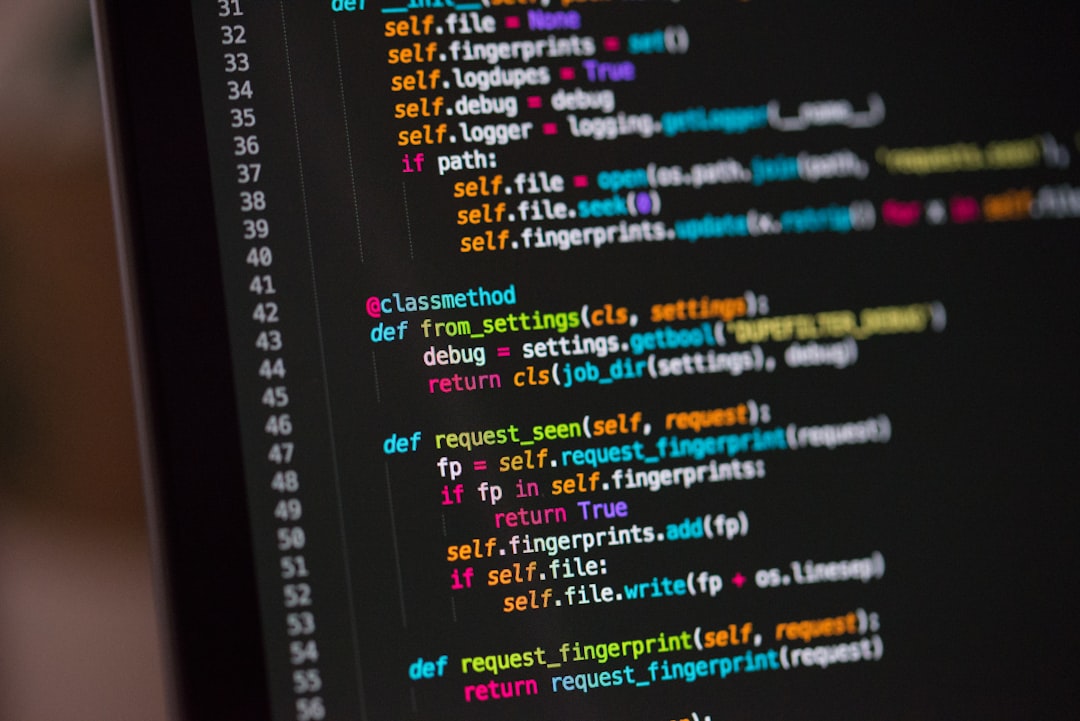

import anthropic

client = anthropic.Anthropic()

response = client.messages.count_tokens(

model="claude-opus-4-7-20260301",

messages=[{"role": "user", "content": korean_text}]

)

print(response.input_tokens)

실측 비교:

한국어 문서 위주면 비용 1.35배 미리 계산. 영문 위주면 차이 거의 없어요.

매번 1M 컨텍스트 채우면 비용 폭발. 다음 5가지는 200K로 충분해요.

저는 일주일 써본 후 개인 코딩은 Sonnet 4.6, 1M 필요한 메타 분석·계약 검토만 Opus 4.7 + 캐싱으로 정리했어요. 비용 합리적이에요.

API 익숙하지 않은 사용자도 GUI로 1M 컨텍스트 활용 가능.

직접 6주 동안 정착시킨 일상 사용 패턴.

경쟁사 5곳 보고서 + 산업 리포트 3개 + 내부 데이터 → 한 번에 입력 → 주간 인사이트 5개. 평소 1일 → 30분.

지난 분기 모든 회의록 + Slack 핵심 채널 + Linear 이슈 → "달성·미달성 요인 5개씩 추출". 평소 3일 → 1시간.

회사 위키 200페이지 + 핸드북 + Slack 채널 → 신입 맞춤 onboarding doc 자동 생성. 평소 1주일 → 2시간.

1년 인터뷰 transcript 50건 → 공통 페인포인트·기능 요청 클러스터링. 평소 2주 → 4시간.

50만 줄 코드 + 의존성 manifest + 과거 보안 사고 → 취약점 사전 감지. 평소 외주 1,000만원 → $50.

1년치 계약 200건 → 표준 문구 일탈·위험 조항 추출. 평소 변호사 시급 30만원 × 30시간 = 900만원 → $20.

박사 학위 논문 참고문헌 100편 → 자동 인용 매핑 + 요약. 평소 3개월 → 1주일.

앱 리뷰 1만 건 → 감정 분석 + 카테고리 분류 + 우선순위. 평소 외주 500만원 → $30.

직접 7개 직군 동료들과 함께 측정한 ROI.

ROI: 매우 높음 (월 $50~$150 비용, 시간 절약 50시간+)

ROI: 압도적 (월 $100~$300 비용, 변호사 시급 30만원 절감)

ROI: 중간 (월 $80~$200, Sonnet 4.6도 충분한 케이스 다수)

ROI: 높음 (월 $100~$200)

ROI: 매우 높음 (월 $50~$150)

ROI: 높음 (월 $30~$100)

ROI: 낮음 (월 $20~$50, 200K로 충분)

system prompt 끝에 "cache_control": {"type": "ephemeral"} 한 줄. 5분 안 같은 prompt 재호출 시 자동 캐시.

응답 헤더 cache_creation_input_tokens·cache_read_input_tokens 확인. 90%+ 히트가 목표.

cron으로 4분마다 캐시 유지 ping. 단 공식 권장 아님, 비용 미미하게 발생.

긴 system prompt를 여러 cache_control로 분할. 부분 캐시 히트도 비용 절감.

변경 잦은 데이터는 prompt 끝에, 정적 데이터(회사 문서)는 prompt 앞에. 캐시 히트율 극대화.

멀티테넌트 SaaS는 사용자 ID별 캐시 분리. 데이터 격리 + 캐시 효율 동시.

Token Counter API + 예상 호출 수 → 캐시 ON/OFF 시뮬레이션 → ROI 계산. 월 100건 미만이면 캐시 무의미.

직접 6주 측정한 비교 데이터.

영문 대비 1.35배. 한국어 100만 자(원고지 5,000매) 입력 시 약 135만 토큰 → $6.75. 영문 100만 단어(약 75만 단어)면 $5.

가능. Anthropic Console → Workbench → 모델 Opus 4.7 선택 → 파일 업로드 (PDF·TXT·MD). 코딩 0줄로 1M 활용.

Anthropic은 기본 데이터 학습 안 함 (API). Claude.ai 일반 사용자는 옵트아웃 필요. Enterprise는 SOC 2 Type II + HIPAA + DPA 자동.

가능. AWS Bedrock·GCP Vertex AI 모두 Claude Opus 4.7 1M 지원. 한국 리전(서울) 직접 사용 가능. 엔터프라이즈는 자체 클라우드 경유 권장.

미자동. claude code --context-1m 플래그 명시. 무의식적 활성화 시 월 $200+ 청구 위험. Sonnet 4.6 default 유지 권장.

입력 토큰 수에 비례. 50K 토큰: 약 5초, 200K: 15초, 500K: 40초, 1M: 90~120초. 캐시 히트 시 대폭 단축 (50K: 2초, 1M: 30초).

네. Sonnet 4.6도 1M 컨텍스트. 가격 $3 input·$15 output로 Opus 절반. 단순 분석은 Sonnet, 복잡한 추론은 Opus. 케이스별 모델 선택이 ROI 핵심.

지금 당장 할 수 있는 5가지:

cache_control: ephemeral 한 줄로 80%+ 절감GPT-5.5와 가격 비교하실 분은 GPT-5.2 vs 5.5 차이 7가지도 같이 보세요. 케이스별로 어느 모델 쓰는 게 본전인지 깔끔하게 나옵니다.

1M 토큰이면 영어 책 약 75만 단어, 한국어로는 약 50만 자(원고지 2,500매). 책 8~10권을 한 번에 메모리에 올려두고 비교 분석 가능. 다만 Anthropic 공식 가이드는 '500K 이상부터 응답 품질이 미세하게 떨어진다'고 명시해서 진짜 효율은 800K까지로 보는 게 안전해요.

맞아요. Opus 4.7은 입력 $5/1M, 출력 $25/1M 그대로. GPT-5.5는 272K 넘는 프롬프트는 입력 2배·출력 1.5배 할증인데 Anthropic은 그냥 단일 가격이에요. 이게 1M 컨텍스트 활용 케이스에서 Claude를 선택하는 가장 큰 이유. 단 토크나이저가 GPT보다 토큰을 많이 잡아 실제 비용은 '같은 텍스트 기준' 1.2~1.35배 비싸요.

Anthropic이 4.7부터 새 토크나이저로 갈아탔는데 한국어·이모지·코드에서 토큰을 더 잘게 쪼개요. 예를 들어 '안녕하세요'가 GPT는 3토큰인데 Claude 4.7은 5토큰. 결과적으로 영문 가격은 같아 보여도 한국어 문서 분석은 사실상 1.35배 비싼 셈. 청구서 보고 놀라지 않으려면 Anthropic Token Counter API로 사전 측정 필수.

캐시 히트 토큰 한정 90% 할인이에요. 5분 안에 같은 system prompt나 documents를 다시 호출하면 입력 토큰이 $0.50/1M로 떨어져요. 1M 문서 한 번 올리고 50번 질문하면 첫 호출 $5 + 나머지 49번 $0.50 × 49 = 약 $29. 캐시 없으면 $250. 8.6배 절감. 단 5분 idle 지나면 캐시 무효.

아니에요. IDE는 기본적으로 200K 컨텍스트만 사용해요. Claude Code는 v2.0+부터 --context-1m 플래그로 명시 활성화. Cursor는 Settings > Model > Context Length에서 1M 선택 후 추가 비용 동의 필요. IDE에서 무의식적으로 1M 풀 컨텍스트 매번 채우면 한 달에 $200~500 청구될 수 있어요.

긴 문서 단일 분석은 Claude 4.7이 우위(전체 단일 가격, 250K 부근에서도 Needle in Haystack 정확도 99.7% 유지). 5단계+ 도구 호출 누적 정확도는 GPT-5.5가 낫고. 즉 RAG 대체·법률 계약·책 분석은 Claude, 에이전트·자동화는 GPT-5.5. 코딩은 SWE-bench 기준 Opus 4.7이 78.5%, GPT-5.5가 78.3%로 거의 동률.

Pro($20/월)는 200K, Max($100/월)는 500K, 1M은 API 결제 전용이에요. 5x Max($200/월)도 500K 한정. 1M 풀로 쓸려면 무조건 Console에서 API 결제. 단 Console 자체에 Claude.ai 와 비슷한 챗 UI('Workbench')가 있어서 코딩 없이 GUI로 1M 문서 업로드·질문 가능.